Fake-Palästina-Foto: Deshalb werden KI-Bilder millionenfach geteilt

Letzte Woche ging ein KI-Bild viral, das auf die Krise in Rafah aufmerksam machen sollte. Ein Experte erklärt, warum KI-Fotos erfolgreicher sind als echte.

Das Wichtigste in Kürze

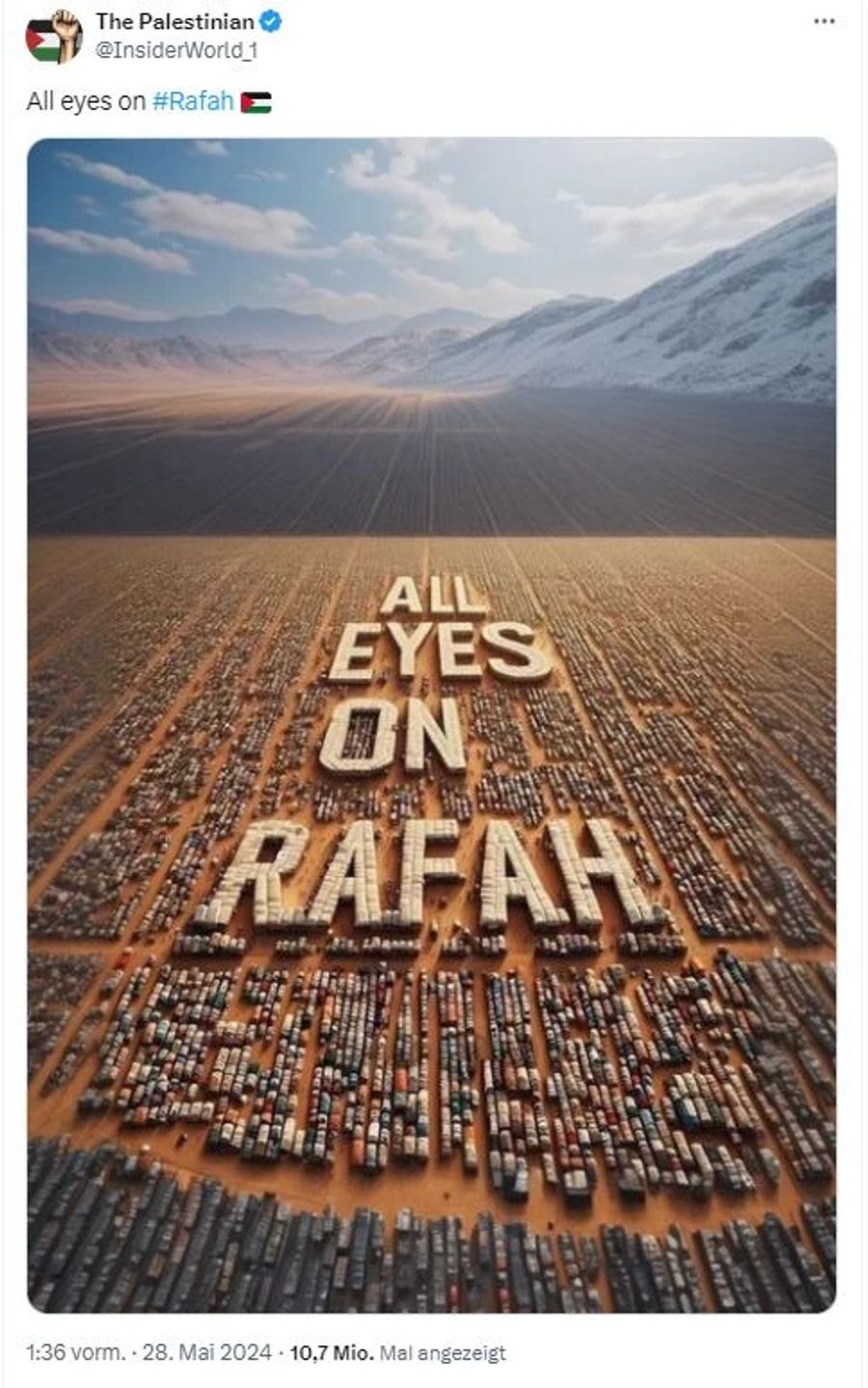

- Ein KI-Bild zum Angriff in Rafah wurde millionenfach auf Social Media geteilt.

- Eine Gegenbewegung forderte, echte Bilder von der Kriegszone zu teilen.

- Sowohl KI-Bilder als auch echte Bilder vermitteln bestimmte Positionen.

Letzte Woche ging auf Social Media ein Bild viral. Infolge der erneuten Eskalation in Rafah teilten mehrere Millionen Menschen auf sozialen Medien ein Bild, das gar nicht echt ist.

Das KI-generierte Bild mit der Nachricht «All Eyes On Rafah» («Alle Augen auf Rafah») wurde von vielen genutzt, um sich mit Palästina zu solidarisieren. Doch: Wenn man es sich anschaut, stutzt man gleich.

Denn das Bild ist bei genauem Betrachten als künstlich erkennbar. Sowohl die weissen Zelte, welche die Parole bilden, als auch die weissen Berge im Hintergrund können nicht echt sein.

Der Krieg läuft seit Monaten, zudem haben Aktivisten und Journalisten bereits viel Bild- und Videomaterial aus Gaza geteilt. Woher kommt also der Rummel um ein Bild, das von künstlicher Intelligenz generiert wurde?

Unklarer Ursprung, blindes Teilen

Daniel Süss, Professor für Medienpsychologie an der ZHAW und Kommunikation an der Uni Zürich, erläutert den Erfolg des KI-Bilds. Mithilfe von KI könnten Symbolbilder generiert werden, die Menschen stark emotional machen.

Solche Bilder vermitteln eine klare Stellung, wie Süss gegenüber Nau.ch sagt. «Sie sind kein Abbild einer Realität, sondern sie transportieren einen Appell oder legen den Betrachtenden eine Perspektive nahe, wie sie ein Ereignis einordnen sollen.»

So sei es auch schwierig, sich kritisch damit auseinanderzusetzen. Dazu komme der Hype, wenn viele Kontakte ein Bild teilten, so Süss. Sprich: wenn jemand aus dem Umfeld etwas teilt, dann teilen Menschen das ebenso.

«Zudem wird durch das vielfache Weiterverbreiten des Bildes die ursprüngliche Quelle immer mehr verwischt, sodass ein kritisches Nachdenken über mögliche manipulative Absichten hinter dem KI-Bild erschwert wird.»

Forderung nach echten Bildern

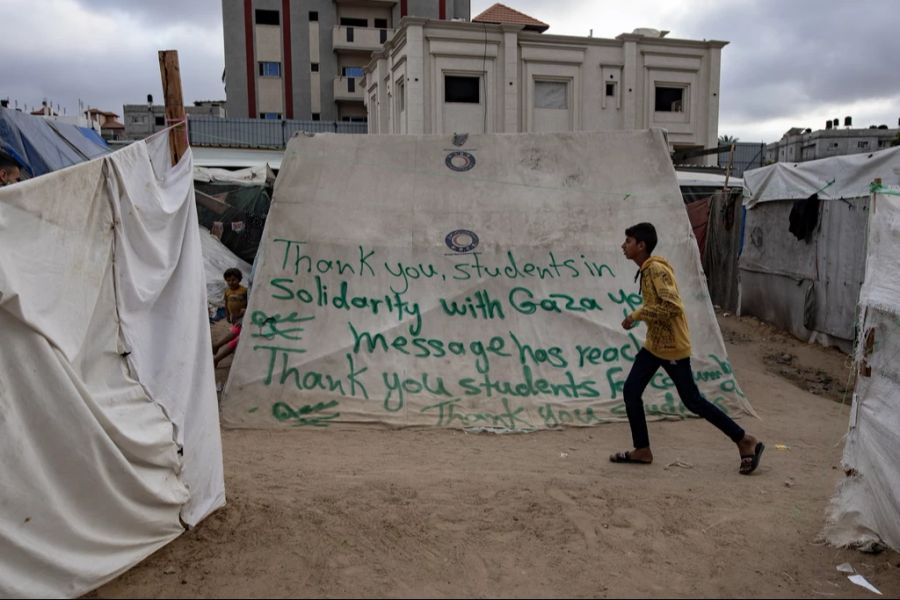

Aktivisten und Aktivistinnen sind nach dem Erfolg des KI-Bilds laut geworden. Obwohl ihnen die Aufmerksamkeit für die Krise in Rafah wichtig ist, geht es um die Verwendung eines KI-Bilds.

Daniel Süss sagt: «Die Kritik von Aktivisten an KI-Bildern kann auch so verstanden werden, dass das Risiko, dass ein Bild als künstlich generiert entlarvt wird, die ganze Message und Glaubwürdigkeit der Absender diskreditiert.»

Diverse Aktivisten bemängelten, dass Menschen das Bild nur teilten, um online gut dazustehen, statt sich mit dem Krieg zu beschäftigen. Dieser sogenannte «performative Aktivismus» bezeichnet Menschen, die zwar öffentlich ihre Anteilnahme zeigen, aber nichts Handfestes unternehmen.

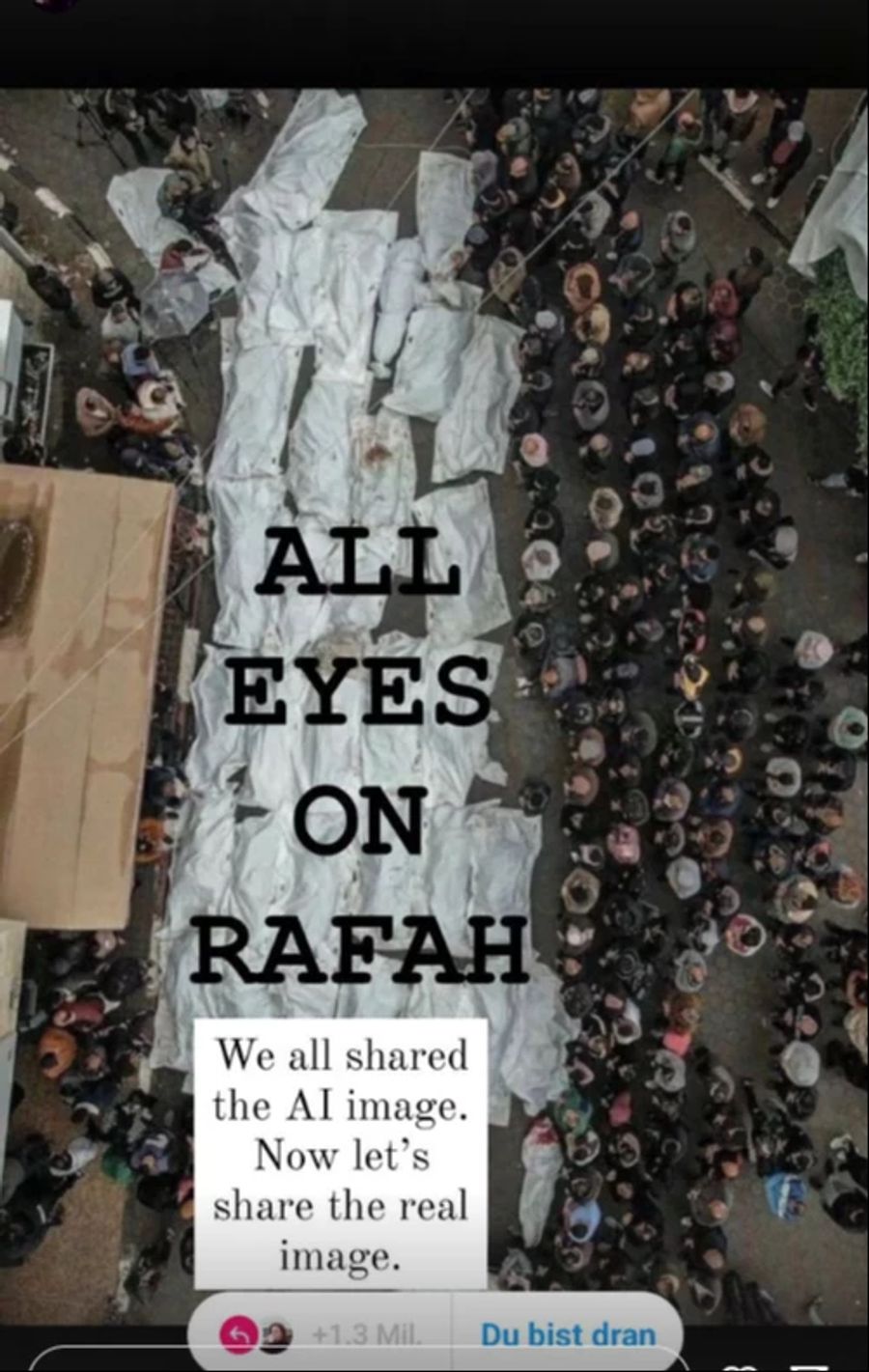

Als Reaktion auf den ersten Post machte ein zweites Bild online die Runde. Diesmal war ein echtes Bild zu sehen – eine Ansammlung von Menschen, die um Leichen stehen.

Laut Daniel Süss sind sich immer mehr Menschen bewusst, dass Bilder in Kriegssituationen manipuliert und für Propaganda verwendet werden. Durch KI nehme dieser Fakt aber neue Dimensionen an.

Hinter der Forderung nach «echten Bildern» steckt der Gedanke, dass sich Menschen ein eigenes Bild der Situation machen. «Das bleibt allerdings eine Illusion, denn auch ein dokumentarisches Bild ist durch die Perspektive, den gewählten Bildausschnitt und die Verbindung von Bild und Textkommentar nie einfach ein neutrales Zeugnis eines Ereignisses.»