So kommen Sie Audio- und Videomanipulationen auf die Spur

Stimmen oder Gesichter in Videos austauschen, ohne dass es jemand merkt? Vor wenigen Jahren war der Aufwand dafür enorm. Heute ist es einfach – eine Gefahr.

Das Wichtigste in Kürze

- «Deepfakes» sind Fälschungen von Bildern oder Audios, die auf KI basieren.

- Erkennbar sind Fälschungen zum Beispiel an verzerrten Stimmen oder verwischten Konturen.

- Dennoch lassen sie sich bei normalem Hinsehen oder Hinhören kaum als solche erkennen.

Es ist vertrackt: Vor allem bewegten Bildern und Stimmen vertrauen wir Menschen intuitiv.

Doch seitdem es möglich ist, selbst dynamische Medien wie Videos und Audiomitschnitte mit vergleichsweise wenig Aufwand und Expertise in hoher Qualität zu fälschen, heisst es: Umdenken.

Die täuschend echten Fälschungen werden mit Hilfe künstlicher Intelligenz (KI) erstellt und lassen sich bei normalem Hinsehen oder Hören kaum noch von echten Videos oder Stimmaufnahmen unterscheiden.

Geboren aus neuronalen Netzen

Die Fälschungen werden auch als Deepfakes bezeichnet, weil die Verfahren zu ihrer Erstellung auf tiefen neuronalen Netzen (deep neural networks) basieren.

Und wie schafft man es, Deepfakes nicht auf den Leim zu gehen? Schon allein das Wissen um ihre Existenz und die Möglichkeiten von KI hilft dabei, nicht mehr per se auf die Echtheit jeglicher Videos oder Audio-Aufzeichnungen zu vertrauen.

Stattdessen gilt es, immer auch Aussagen und Plausibilität kritisch zu hinterfragen.

Handwerklich nicht immer perfekt

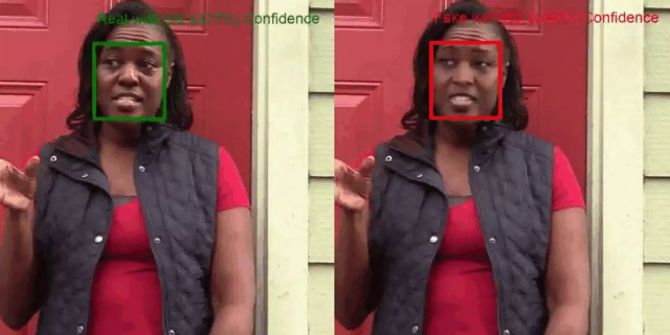

Aber auch technisch kann es durchaus Hinweise geben, die Fälschungen entlarven können.

Dazu zählen etwa Artefakte bei Gesichtsübergängen, verwaschene Konturen, begrenzte Mimik oder unstimmige Belichtung bei Videos.

Metallischer oder monotoner Klang, falsche Aussprache oder unnatürliche Sprechweise sowie unnatürliche Geräusche oder Verzögerungen sind typische Fehler bei Stimmfälschungen.

Künftig könnte es aber auch kryptografische Verfahren geben, die die Quelle von Video- oder Audio-Material eindeutig mit einer Identität verknüpfen.

Das ist ein Ausblick darauf, wie zukünftig Deepfakes verhindert werden könnten.

Dazu zählen auch zahlreiche Methoden zur automatisierten Erkennung manipulierter Daten, an denen Wissenschaftler arbeiten.