OpenAI-Chef: KI könnte helfen, biologische Kampfstoffe zu entwickeln

Sam Altmans Firma OpenAI hat im November ChatGPT auf den Markt gebracht. In einem Interview warnt der 38-Jährige nun vor den Gefahren Künstlicher Intelligenz.

Das Wichtigste in Kürze

- OpenAI-Chef Sam Altman fordert strenge Regulierungen für KI.

- Es sei wichtig, dass wir als Menschen die Kontrolle über diese Technologien behalten.

- Er ist besorgt, dass mithilfe von KI biologische Kampfstoffe entwickelt werden könnten.

Seit rund einem halben Jahr ist ChatGPT öffentlich zugänglich. Bereits nach kurzer Zeit verzeichnete der Chatbot weltweit über 100 Millionen Nutzerinnen und Nutzer. Sam Altman, dessen Firma OpenAI die KI-Software entwickelte, hat nun vor Kurzem vor dem US-Senat strenge Regeln für KI gefordert.

«Es ist entscheidend, dass wir in einem demokratischen Prozess die Grenzen für diese Technologie bestimmen und als Menschen die Kontrolle behalten», erklärt er in einem Interview mit dem «Spiegel». Auch als Unternehmen brauche OpenAI Klarheit und sollte deshalb laut Altman reguliert werden.

«Es gibt immer Leute, die Technologie missbrauchen»

Künstliche Intelligenz könne zwar dafür eingesetzt werden, viel Gutes zu schaffen. Er sei sich sicher, dass die grosse Mehrheit der Menschen diese «mächtigen Werkzeuge» produktiv einsetzen werden. «Aber natürlich gibt es immer Leute, die Technologie missbrauchen – und dagegen müssen wir vorgehen», erläutert der OpenAI-Chef.

Ein Risiko bei KI sieht er in biologischen Bedrohungen: «Ich bin sehr besorgt, dass mithilfe von KI-Systemen biologische Kampfstoffe entwickelt werden könnten.» Gleichzeitig werde man dank KI aber auch bessere Impfstoffe finden.

Was ihn auch beunruhige, seien neue Formen von «überzeugenden, massgeschneiderten, interaktiven Desinformationsbotschaften» – etwa durch KI-basierte Deepfakes. Dafür brauche es laut Altman neue gesellschaftliche Abwehrkräfte, an denen schon gearbeitet werde.

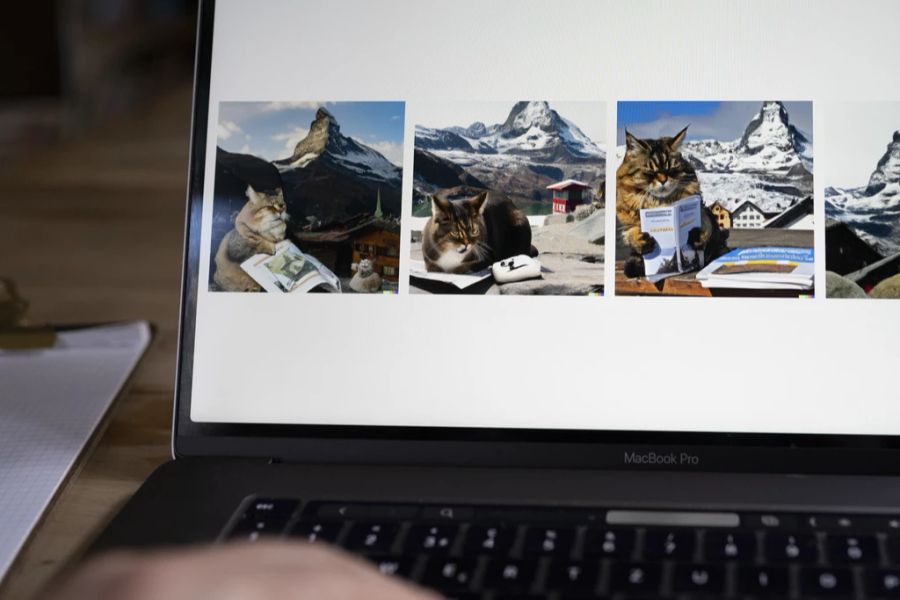

Sollen KI-generierte Bilder als solche gekennzeichnet werden

Denkbar wären aus seiner Sicht Detektoren, die künstlich generierte Bilder automatisch aufspüren könnten. «Wir könnten auch gesetzlich vorschreiben, dass KI-generierte Bilder als solche gekennzeichnet werden müssen, durch digitale Wasserzeichen etwa.»

Sein Unternehmen setze im Kampf gegen Missbrauch Sicherheitsbeauftragte und Leute ein, «die daran forschen, unsere Modelle entsprechend anzupassen». Er ist sich sicher: «Wenn Sie es nutzen wollen, um damit Bomben zu basteln, wird es das verweigern.»

Es gebe ein Monitoring-System, das problematische Verhaltensweisen erkenne. «Selbst unsere harschesten Kritiker haben eingeräumt, dass wir die Sicherheit diesmal wirklich grossgeschrieben haben», so Altman.