ChatGPT: Lehrer nutzen KI für Schülerberichte mit sensitiven Daten

Die künstliche Intelligenz ChatGPT ist auch im Lehrerzimmer angekommen. Weil das auch heikel sein könnte, fordert der Lehrerverband nun Richtlinien.

Das Wichtigste in Kürze

- Nicht nur Schüler, auch Lehrer nutzen ChatGPT.

- So gelangen teils sensitive Daten ins System.

- Deshalb fordert der Lehrerverband nun einheitliche ethische Richtlinien.

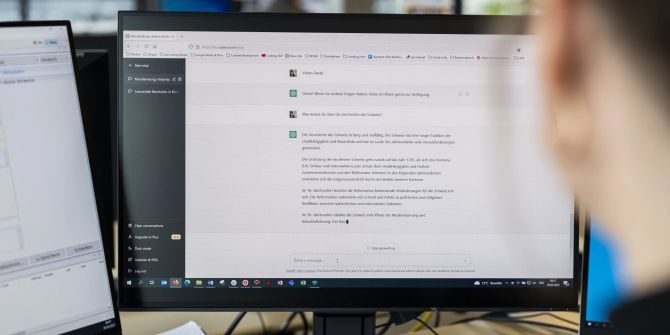

Hat ein Schüler eine Lernschwäche, erstellt seine Lehrerin oder sein Lehrer oft einen Bericht darüber. Einige Lehrpersonen holen sich dabei Hilfe und schreiben den Bericht mit der künstlichen Intelligenz ChatGPT.

Doch das birgt auch Probleme. Denn damit gelangen teils sensitive Daten – in diesem Fall die Details über den Schüler – ins System. Der Lehrerdachverband LCH fordert darum nun, dass einheitliche ethische Richtlinien im Umgang mit KI und sensitiven Daten geschaffen werden.

Denn welche Daten die Lehrer in solche Schreibhilfen eingeben dürfen, sei häufig noch unklar. «Es gibt keine klaren Anweisungen an Lehrpersonen, was sie machen dürfen und was nicht», sagt Beat Schwendimann, Geschäftsleitungsmitglied des Verbands, gegenüber SRF.

Die eingegebenen Daten würden allesamt in die Datenbank von ChatGPT aufgenommen. «Und da braucht es entsprechende Vorgaben, wie man mit solchen sensitiven Daten umgeht», so Schwendimann weiter. Es sei an Bund und Kantonen, dies zu tun.

Denn gefährlich könnte es zum Beispiel werden, wenn jemand später feststelle, dass sensitive persönliche Daten aus seiner Schulzeit über ein KI-System verfügbar sind.

Die Fachagentur Educa empfiehlt den Lehrpersonen, solche heiklen Berichte aus der eigenen Feder zu schreiben. Sie könnten mit Applikationen wie ChatGPT zwar spielen, sollten aber keine personenbezogenen Daten eingeben, sagt Educa-Direktor Toni Ritz zu SRF.